Mi történt

A TechCrunch Equity podcast friss epizódjában Rebecca Bellan a Runway társalapítójával és vezérigazgatójával, Cristóbal Valenzuelával beszélget arról, merre tart az AI-videógenerálás, és miért gondolja a cég, hogy a fókusz hamar túl fog nőni a filmiparon.A Runway helyzete nem kicsi: a cég (a TechCrunch szerint) közel 860 millió dollár tőkét vont be, és 5,3 milliárd dolláros értékelés mellett építkezik. A podcast leírása alapján a Runway modelljei már most olyan, rendkívül tőkeerős szereplőkkel versenyeznek, mint a Google vagy az OpenAI — legalábbis az AI-videó területén.

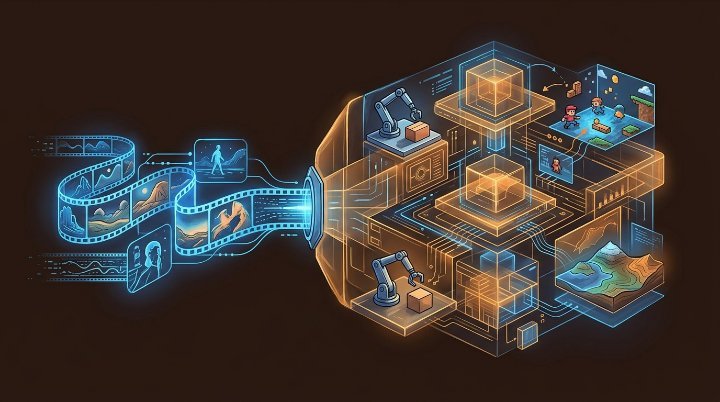

A beszélgetés kulcspontja, hogy a Runway a videógenerálást egy nagyobb irány részeként kezeli: a cég „world modellek” felé mozdulna. Gondolj erre úgy, mint egy olyan AI-ra, ami nem pusztán képkockákat rajzol egymás után, hanem megtanulja, hogy a világban mi mivel hogyan függ össze (például mozgás, fizika, ok-okozat), és erre építve képes jeleneteket, interakciókat, akár környezeteket „lejátszani”. A TechCrunch szerint ennek célterülete lehet a gaming, a robotika, és tágabban valami, ami már a „általános intelligencia” felé mutat.

A podcast ígérete szerint szó esik még arról is, hogy Valenzuela miért gondolja: a filmkészítés valódi korlátja eddig nem a technológia volt — és mi változik, ha mégis azzá válik (vagy épp megszűnik annak lenni). Emellett előkerül a Runway nézőpontja arról, miben gondolkodnak másként a world modellekről, mint például a Google és más, hasonló irányba építkező laborok.

Miért fontos

A „world modellek” azért érdekesek, mert a videógenerálásnál egy lépéssel mélyebbre mennek. A videó ma gyakran kimenet: megkéred a modellt, hogy készítsen egy jelenetet, és kapsz egy klipet. A world modell logikája inkább rendszer: olyan, mintha nem egy kész filmet kérnél, hanem egy „mini világot”, ahol a kamera, a szereplők és a történések következetesen reagálnak egymásra.Ez kapcsolódik a podcastban említett „nonlinear media” (nemlineáris média) fogalmához is. Egyszerűen: nem egy előre rögzített történetet nézel végig elejétől a végéig, hanem a tartalom interaktív, elágazó, és részben valós időben alakul. Gondolj rá úgy, mint a film és a videojáték közötti határ elmosódására — ahol a videó nem egy exportált fájl, hanem egy folyamatosan generált „élő” felület.

Valenzuela a beszélgetésben (a leírás szerint) kitér arra is, hogy nem ért egyet azzal az állítással, miszerint az AI-társak „eleve disztópikusak”. Ez nem technikai részlet, hanem fontos jelzés: a Runway narratívája nem csak kreatív eszközökről szól, hanem arról is, hogyan képzelik el az emberek és az AI kapcsolatát a következő platformváltásban.

Mire figyelj

- A „valós idejű” generálás tényleges minősége: a real-time videógenerálás ígérete nagy, de a használhatóságot a stabilitás, következetesség (karakterek, tárgyak, tér) és késleltetés fogja eldönteni.

- World modellek: mire lesznek először jók? A gaming és a robotika említése sokatmondó, de érdemes figyelni, hogy a Runway milyen konkrét, kézzelfogható demókkal és termékekkel támasztja alá az ambíciót.

- Verseny a nagy laborokkal: ha a Runway valóban „túl Hollywoodon” építkezik, akkor a versenytér nem csak a kreatív szoftverek piaca, hanem a nagy AI-platformoké is. A kérdés az, miben tudnak tartósan különbözni.

- Nemlineáris média mint új platform: ha az interaktív, generált videó elindul, az nemcsak alkotói workflow-t, hanem terjesztést, jogokat és üzleti modelleket is átrendezhet.