Mi történt

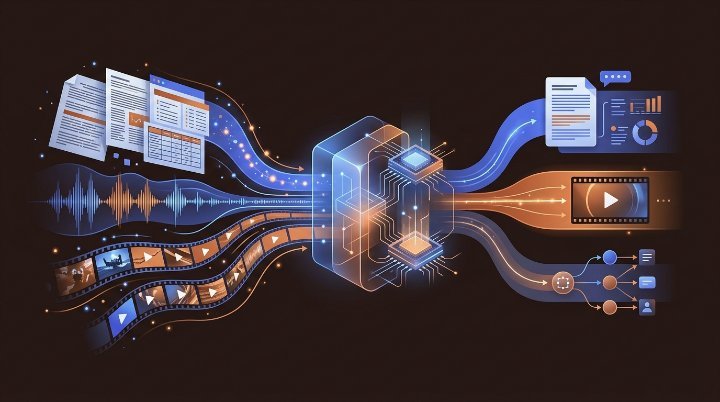

Az NVIDIA bemutatta a Nemotron 3 Nano Omni modellt a Hugging Face blogján: egy omni-modális (szöveg + kép + videó + hang) megértő modellt, amit dokumentumelemzésre, többképes következtetésre, automatikus beszédfelismerésre (ASR), hosszú audio-videók értelmezésére, valamint „agentic” (ügynökszerű) számítógép-használatra és általános következtetésre pozicionálnak.A poszt szerint a Nemotron multimodális vonalát viszi tovább: a korábbi, erős vision-language (kép+szöveg) fókuszról egy szélesebb text+image+video+audio rendszerre bővít. A modell állításuk szerint több benchmarkon is élmezőnyben szerepel: dokumentum-intelligenciában (például MMLongBench-Doc, OCRBenchV2), videó és audio feladatokban (például WorldSense, DailyOmni), illetve hangértésben (VoiceBench). Külön kiemelik, hogy a MediaPerf alapján „a legköltséghatékonyabb” nyílt videómegértő modellként rangsorol.

A technikai felépítésről is adnak kapaszkodót: a gerinc egy Nemotron 3 hibrid Mamba–Transformer Mixture-of-Experts (MoE) backbone, ehhez társul egy C-RADIOv4-H látás-enkóder és egy Parakeet-TDT-0.6B-v2 audio-enkóder. Gondolj erre úgy, mint egy közös „agyra” (nyelvi gerinc), amihez külön „érzékszervek” csatlakoznak (kép- és hang-enkóder), majd a rendszer mindezt egy közös reprezentációban próbálja összefésülni.

A tréningről a forrás azt írja, hogy lépcsőzetes multimodális igazítást (alignment) és kontextus-bővítést használtak, majd preferencia-optimalizáció és multimodális megerősítéses tanulás (RL) következett. Magyarul: először megtanítják a különböző modalitások „összebeszélését”, utána kitolják, mennyi anyagot tud egyszerre kezelni, végül pedig finomhangolják a válaszok minőségét emberi/heurisztikus preferenciákhoz hasonló célok mentén.

A modell elérhető többféle súlyformátumban (BF16, FP8, NVFP4) a Hugging Face-en. Ezek a jelölések a számábrázolás pontosságára/kvantálására utalnak: minél „tömörebb” (pl. FP8, NVFP4), annál kisebb memória- és gyakran nagyobb sebesség, cserébe potenciális pontossági kompromisszumokkal — hogy ez nálad hol optimális, az erősen use-case függő.

Miért fontos

Az érdekes itt nem az, hogy „van még egy multimodális modell”, hanem az, hogy a poszt szerint kifejezetten hosszú, összetett, kevert bizonyítékokra tervezték. A dokumentumoknál például nem áll meg az OCR-nél: olyan anyagokra céloz, ahol a megértéshez kell a layout (elrendezés), táblázatok, ábrák, képletek, fejezetstruktúra és a több oldalon átívelő hivatkozások kezelése. A forrás explicit említi a 100+ oldalas dokumentumokat (szerződések, műszaki anyagok, jelentések, kézikönyvek, compliance csomagok).A másik gyakorlati nyereség a „valós élet” audio-videó: sok vállalati anyag eleve képernyőfelvétel narrációval, meeting diával, oktatóvideó, support felvétel. Ha egy modell tényleg együtt tud érvelni a képi és a hang információval, az csökkentheti a pipeline-ok ragasztgatását (külön ASR → külön videó címkézés → külön LLM összefoglaló), és egyszerűbbé teheti a visszakeresést és kérdezz-felelek jellegű feldolgozást.

A „GUI-ügynök” irány pedig azért számít, mert sok automatizálás nem API-kon, hanem képernyőn keresztül történik. A forrás alapján a modellt direkt úgy tréningezték, hogy képernyőképeket értelmezzen, a UI állapotát kövesse, és a következtetését a látott elemekhez „lehorgonyozza” (grounding). Ez a gyakorlatban például stabilabb lépésválasztást jelenthet egy többképernyős folyamatban — legalábbis ez a cél.

Mire figyelj

- A „best-in-class” állítások értelmezése: a poszt több leaderboardot és számot sorol (pl. MMLongBench-Doc, OCRBenchV2, VoiceBench). Érdemes megnézni, hogy a saját feladatod mennyire hasonlít ezekre (nyelv, dokumentumtípus, zajos audio, domain-specifikus vizuális elemek).

- Kontextushossz a gyakorlatban: a forrás 100+ oldalas dokumentumokról beszél. A valódi kérdés: milyen pontossággal talál vissza kereszthivatkozásokat, táblázatcellákat, lábjegyzeteket, és mennyire stabil a hosszú láncú következtetés.

- Sebesség és költség: az NVIDIA a multimodális use-case-ekben akár 9× throughputot és 2,9× single-stream reasoning speedet említ alternatívákhoz képest, illetve rendszerhatékonysági előnyöket (multi-documentnél 7,4×, videónál 9,2×). Ezek tipikusan erősen függnek a hardvertől, a batch-eléstől és a kvantálástól — érdemes a saját infrastruktúrán mérni.

- Súlyformátum-választás (BF16 vs FP8 vs NVFP4): ha termékbe viszed, a legjobb kompromisszumot nem a benchmark, hanem a célkésleltetés, a költségkeret és a minőségi elvárás adja. Kezdd BF16-tal validálni a minőséget, és utána menj lefelé tömörítésben.

- Omni-modális „mindenes” vs specialista: a forrás alapján a modell erőssége az integrált, vegyes bizonyíték. Ha neked csak tiszta ASR kell vagy csak OCR, lehet, hogy egy specialista modell olcsóbb/egyszerűbb — viszont ha a végén úgyis össze kell kötni a modalitásokat, az omni megközelítés gyorsíthatja a fejlesztést.