Mi történt

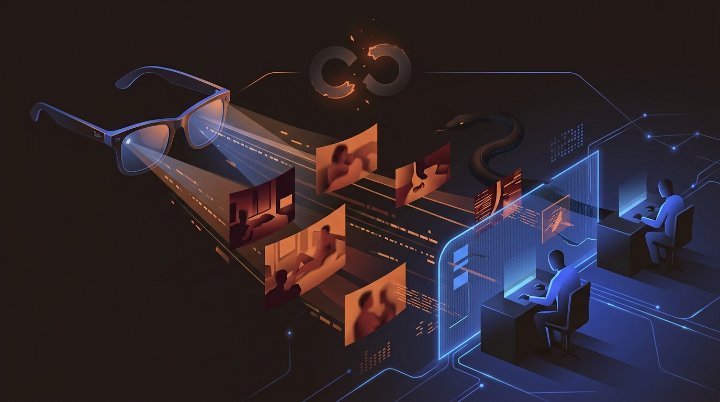

Kenya-i szerződéses munkások arról számoltak be, hogy a Meta Ray-Ban AI okosszemüvegével készült, zavarba ejtően intim videókat és képeket kellett átnézniük. A beszámolók szerint előfordult meztelenség, vécéhasználat, sőt teljes „szexjelenetek” is. Egy esetben egy férfi a hálószobában az asztalon hagyta a szemüveget, miközben a felesége vetkőzött — a felvétel így bekerült a felülvizsgálandó anyagok közé.A munkások szerint a feladat lényege az volt, hogy emberi szem ellenőrizze és címkézze (annotálja) a tartalmakat. Az annotálás olyan, mint amikor egy gyakornoknak kézzel kell ráírnia több ezer képre, hogy „ez egy kutya”, „ez egy autó” — csak itt videókról van szó, és a „mit látunk” néha nagyon személyes. A cél, hogy a szemüveg beépített AI-funkciói pontosabban működjenek.

Két hónappal azután, hogy a vádak nyilvánosságot kaptak, a Meta megszüntette a szerződését a kenyai Sama nevű céggel (a BBC beszámolója alapján). A Meta azt közölte, hogy a döntés oka: a beszállító nem felelt meg a vállalati sztenderdeknek, miközben hangsúlyozta, hogy komolyan veszi a munkások állításait. A Sama ezzel szemben azt állította, hogy következetesen teljesítette a biztonsági és minőségi elvárásokat, és nem jelezték feléjük, hogy problémák lennének.

Miért fontos

A történet több réteget érint egyszerre: adatvédelem, munkahelyi kiszolgáltatottság és az AI-fejlesztés „láthatatlan” emberi oldala. A felhasználók gyakran úgy gondolnak az AI-ra, mint egy autonóm rendszerre, pedig a gyakorlatban sokszor emberek tanítják és finomhangolják — ráadásul gyakran alvállalkozói láncokban, távoli országokban. Közben az okosszemüveg mint forma különösen érzékeny: könnyebb „véletlenül” rögzíteni intim helyzeteket, és nehezebb a környezetnek észrevennie, hogy épp felvétel készül.Mire figyelj

- A felvételjelzők valós védelme: hiába van jelzőfény a rögzítéshez, ha az kikapcsolható vagy eltakarható, a társas normák és a beleegyezés könnyen sérül.

- Mit jelent a „hozzájárulás” a gyakorlatban: a Meta azt állítja, hogy a felhasználók egyértelmű beleegyezést adnak az emberi felülvizsgálathoz. Érdemes figyelni, mennyire érthető és mennyire részletes ez a tájékoztatás, és mire terjed ki.

- Hatósági reakciók: az Egyesült Királyság adatvédelmi hivatala megkereste a Metát a „aggasztó” jelentések miatt, Kenyában pedig adatvédelmi vizsgálatot jelentettek be. Ezek kimenetele precedenst teremthet a viselhető AI-eszközök adatkezelésére.

- A beszállítói lánc kockázatai: ha egy botrány után az első reakció a szerződés felmondása, az nem feltétlenül oldja meg a rendszerszintű problémát — csak arrébb tolja. A Futurism AI által idézett munkavállalói érdekvédők szerint a „sztenderdek” kérdése akár a titoktartásról is szólhat.