Mi történt

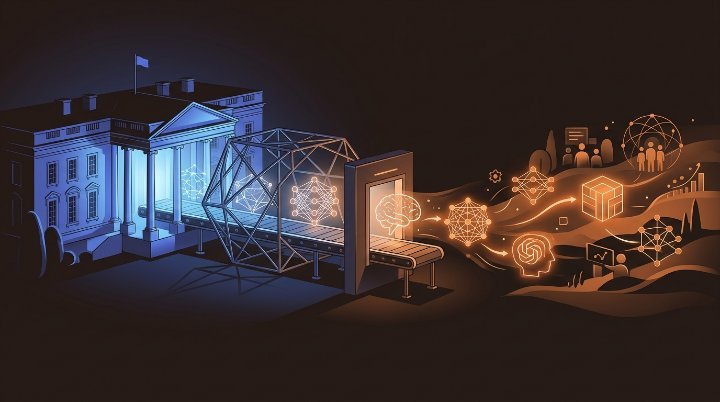

A Fehér Ház egy új, AI-fejlesztést felügyelő munkacsoport létrehozását fontolgatja. A felmerült ötletek között szerepel, hogy a bizottság jogosultságot kaphatna az új AI-modellek szövetségi szintű felülvizsgálatára még azelőtt, hogy azokat a cégek nyilvánosan elérhetővé tennék.A konkrét megoldás egyelőre nem eldöntött, és az is benne van a pakliban, hogy a terv végül nem valósul meg. Az elképzelés iránya ugyanakkor emlékeztethet egy olyan modellre, ahol több egymásra épülő ellenőrzési szint igazolja, hogy a rendszer megfelel bizonyos biztonsági követelményeknek — gondolj rá úgy, mint amikor egy új gyógyszer vagy repülőgép-alkatrész nem kerülhet forgalomba pusztán a gyártó ígérete alapján, hanem előre definiált teszteken és auditokon kell átmennie.

Miért fontos

Ez a gondolatmenet látványos elmozdulás lenne a korábbi, inkább önszabályozásra támaszkodó megközelítéshez képest: a „majd a piac és a vállalati felelősség megoldja” logikája helyett megjelenne egy kapuőr-szerep. A hétköznapi felhasználónak ez két dolgot jelenthet: egyrészt nagyobb eséllyel szűrnék ki a nyilvánvalóan veszélyes vagy könnyen visszaélésre alkalmas modelleket (például amelyek túl könnyen adnak útmutatót károkozáshoz, vagy kezelhetetlenül szivárogtatnak érzékeny adatokat). Másrészt viszont lassíthatja a bevezetéseket, és felértékeli a „megfelelőség” (compliance) szerepét — vagyis azt, hogy egy cég mennyire tudja dokumentálni, mérni és bizonyítani a modellje kockázatait.Mire figyelj

- Mit jelent pontosan a „felülvizsgálat”? Kötelező engedélyeztetés lesz, vagy csak bizonyos kockázati szint felett? És milyen tesztek számítanak: biztonsági (misuse), adatvédelmi, diszkriminációs, kiberbiztonsági?

- Kikre vonatkozna? Csak a legnagyobb, „frontier” (csúcskategóriás, általános célú) modellekre, vagy a kisebb, nyílt forrású és specializált rendszerekre is?

- Mi a mérce és ki méri? Ha a szabványok homályosak, a felülvizsgálat könnyen politikai vagy piaci viták terepe lesz. Ha túl szigorúak, a kisebb szereplők kiszorulhatnak.

- Marad-e önszabályozás, és milyen arányban? Az Engadget AI felvetése alapján a mostani gondolat kifejezetten nagy irányváltás lenne a korábban lazább hangvételhez képest — érdemes figyelni, hogy ez valódi szabályozási fordulat, vagy inkább egy jelzésértékű, korlátozott hatáskörű testület lesz.

Engadget AI – https://www.engadget.com/2164390/the-white-house-is-considering-tighter-regulation-of-new-ai-models/