Mi történt

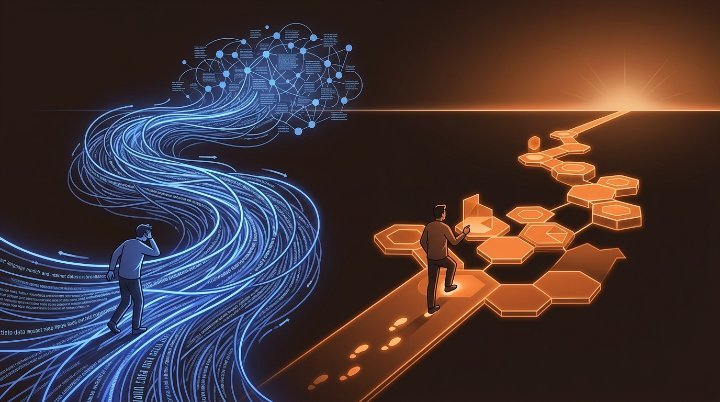

A WIRED portréja David Silver nézeteit mutatja be, aki a DeepMindnál az AlphaGo-hoz kötődő áttörések egyik vezető alakja volt. Silver szerint a mai AI-fejlesztés domináns iránya—különösen a nagy nyelvi modellek (LLM-ek) köré épülő világ—túl erősen támaszkodik az interneten összegyűjtött emberi szövegekre és mintákra.A nagy nyelvi modellre gondolj úgy, mint egy elképesztően fejlett „szöveg-autokorrektre”: rengeteg példából megtanulja, hogy egy adott szövegkörnyezetben mi következik valószínűleg. Ettől tud meggyőzően írni, összefoglalni, kódot generálni—de Silver kritikája szerint ez a megközelítés könnyen plafonba ütközik, mert alapvetően mások nyomait követi, nem pedig saját tapasztalatból épít fel tudást.

Silver ezzel szemben a megerősítéses tanulást (reinforcement learning, RL) helyezi előtérbe. Ez az a módszer, amellyel az AlphaGo is kiemelkedőt tudott: a rendszer nem csupán „megnézte”, hogyan játszanak az emberek, hanem sok-sok próbálkozáson keresztül, visszajelzések alapján tanult. Gondolj rá úgy, mint amikor valaki nem receptet olvas, hanem újra és újra főz, kóstol, javít—és ettől lesz igazán jó.

Miért fontos

A vita nem akadémiai: arról szól, hogy miből lesz a következő generációs AI-képesség. Az LLM-ek erőssége a nyelv és a mintázatok kezelése, de a hétköznapi felhasználó is látja a korlátokat: magabiztos tévedések, következetlenségek, nehezen ellenőrizhető „okoskodás”. Silver nézőpontja szerint ezek nem puszta gyermekbetegségek, hanem részben abból fakadnak, hogy a modellek elsődlegesen statisztikai mintakövetésből élnek.Az RL-alapú megközelítés ígérete az, hogy a rendszer célok mentén, „világban” (akár szimulációban) szerzett tapasztalatokból tanuljon. Ez közelebb áll ahhoz, ahogy a készségeket a valóságban is elsajátítjuk: nem csak leírásokból, hanem cselekvésből és következményekből. Ha ez működik, az olyan AI-k felé mutat, amelyek nem csak beszélnek a problémákról, hanem stabilabban meg is oldják őket.

Mire figyelj

- Merre mozdulnak a nagy laborok a következő 1–2 évben? Ha a hangsúly a „tapasztalatból tanuló” rendszerek felé tolódik (szimuláció, önjátszás, célvezérelt tanulás), az Silver irányának erősödését jelezheti.

- Hogyan kombinálják a nyelvi modelleket és az RL-t? A gyakorlatban nem „vagy-vagy” a kérdés: az izgalmas fejlesztések ott jöhetnek, ahol a nyelvi készségek mellé megbízhatóbb döntéshozatal és visszacsatolt tanulás társul.

- Mennyire tudják a rendszerek ellenőrizhetően javítani a saját hibáikat? Az RL egyik ígérete a folyamatos, mérhető fejlődés. Ha a termékekben is megjelenik a következetesebb, tesztelhető teljesítmény (nem csak „szebb szöveg”), az kézzelfogható fordulat lehet.