Mi történt

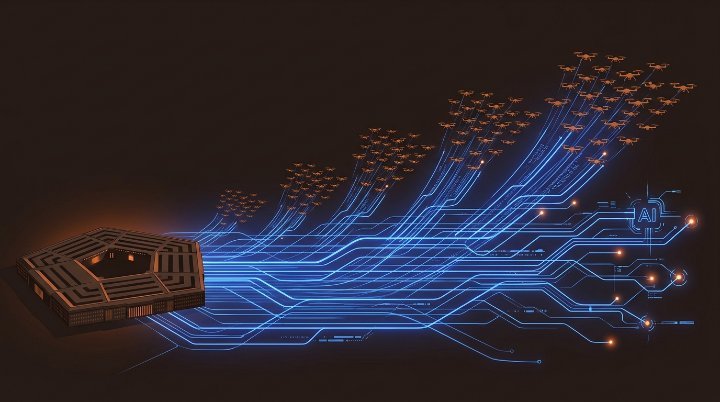

A The Guardian által idézett friss költségvetési dokumentumok szerint a Pentagon a 2027-es büdzséjében több mint 54 milliárd dollárt kér a Defense Autonomous Warfare Group (DAWG) finanszírozására. Ez a tavalyi szinthez képest 24 000%-os (azaz több mint százszoros) növekedés, és a lap szerint egyértelmű jelzés: az Egyesült Államok erősen az AI-vezérelt hadviselés felé fordul.A költségvetési összefoglaló alapján a pénz „autonóm és távirányított rendszerekre” menne levegőben, szárazföldön, valamint a tenger felszíne felett és alatt – ideértve a „Drone Dominance” programot is. Összehasonlításként: a cikk szerint ez az összeg több mint a fele az Egyesült Királyság teljes védelmi költségvetésének.

A téma politikai- és szakértői visszhangja is erős. David Petraeus volt CIA-igazgató egy véleménycikkben ezt „a történelem legnagyobb egyszeri elköteleződésének” nevezte az autonóm hadviselés mellett, ugyanakkor ő és mások is figyelmeztettek: a hadsereg és az AI-cégek nincsenek felkészülve az autonóm fegyverrendszerek kockázataira és felelősségi kérdéseire.

A Guardian megszólaltatott több, AI-biztonsággal foglalkozó szakértőt is. Jeffrey Ladish (Palisade Research, korábban Anthropic) szerint az autonóm rendszerek megváltoztathatják a katonai konfrontáció dinamikáját, például könnyebbé és gyakoribbá tehetnek olyan eseményeket, mint a puccsok. Peter Wallich (korábban a brit AI Security Institute, jelenleg az MIT AI Risk Initiative tanácsadója) arra hívta fel a figyelmet, hogy a tesztek során még a legfejlettebb rendszereknél is találnak kihasználható hibákat; a brit intézet decemberi vizsgálatai során minden tesztelt „frontier” (élvonalbeli) AI-rendszernél voltak kijátszható védelmi korlátok – és egy védelmi kontextusban ez katonák és civilek életét veszélyeztetheti.

A cikk kitér arra is, hogy a Pentagon hónapok óta vitában áll az Anthropic-kal, miután a vállalat megpróbálta megtiltani, hogy a modelljét tömeges megfigyelésre vagy teljesen autonóm halálos fegyverekhez használják. Ezzel párhuzamosan a Pentagon a költségvetési kérelmében megerősítette: a védelmi minisztériumon belül „a legjobb amerikai élvonalbeli AI-laborok legfrissebb modelljeit” kívánja beszerezni.

Szervezeti oldalról a DAWG egy újonnan létrehozott Pentagon-egység, amely magába olvasztott egy korábbi, Biden-korszakbeli kezdeményezést is: ez olcsó drónok beszerzését célozta a csendes-óceáni jövőbeli konfliktusokra készülve. A Guardian szerint ugyanakkor nem világos, hogy az 54 milliárd dollár inkább kész technológiák beszerzésére vagy új fejlesztésekre menne; a hivatalos cél a magánszektorral közös tesztelés, majd a rendszerek integrálása.

A finanszírozás beleillik abba a tágabb amerikai törekvésbe is, hogy a védelmi technológiai ellátási lánc bizonyos részeit leválassza Kínáról: tavaly decemberben széleskörű tiltásokat vezettek be kínai drónokra és komponensekre.

A potenciális nyertesek között a cikk említi a nagyobb szereplőket (például Palmer Luckey Andurilját) és több startupot (Neros, Skydio, Powerus – utóbbit Donald Trump két idősebb fia is támogatja). Van azonban kritika is: Kristofer Harrison (volt külügyminisztériumi Oroszország-szakértő) szerint a keret „Anduril-szuszogó alapnak” is tűnhet, és felveti, hogy az USA jobban járna, ha ukrán dróngyártókkal dolgozna, akik a fronton kipróbált, olcsóbb és nagyobb volumenben gyártott eszközöket készítenek.

Miért fontos

A „autonóm” itt nem marketingcímke, hanem működési modell: gondolj rá úgy, mint amikor a drón nem csak távirányítással repül, hanem bizonyos feladatokat – például útvonal-tervezést, célfelismerést, kötelékben mozgást – részben vagy egészben szoftveresen old meg. Ez gyorsaságot és skálázhatóságot ad, de egyben új hibamódokat is: ha egy AI-t félre lehet vezetni (például szenzorok, képi minták, kommunikációs zavarás vagy egyszerűen rossz környezeti feltételek miatt), az nem „csak” egy app összeomlása, hanem fizikai kár és emberélet kérdése.A másik nagy tét a doktrína és felelősség. Petraeus szerint az USA-nak jelenleg nincs kiforrott katonai doktrínája arra, hogyan vessen be autonóm alakzatokat (például drónrajokat), és a vezetőknek komoly képzésre lenne szükségük az ilyen rendszerek irányításához. Magyarul: hiába van pénz és hardver, ha nincs meg az a „használati kézikönyv” és szervezeti rutin, ami eldönti, mikor mit szabad rábízni a gépre, és mikor kell emberi kontroll.

Mire figyelj

- Mire megy el ténylegesen az 54 milliárd? Beszerzésre, K+F-re, tesztpályákra, integrációra, kiképzésre – vagy ezek keverékére. Ez dönti el, hogy gyors „polcról levevős” képesség épül-e, vagy hosszabb, kockázatosabb fejlesztési program.

- Mit jelent a gyakorlatban az „autonóm” és a „távirányított” arány? A jogi és etikai viták kulcsa, hogy lesz-e „ember a döntési láncban” (human-in-the-loop), és pontosan hol.

- AI-biztonsági tesztelés és auditálhatóság: ha a szakértők szerint a legfejlettebb modellek védelmi korlátai is kijátszhatók, akkor kritikus lesz, milyen kötelező tesztelési, naplózási és ellenőrzési standardokat írnak elő.

- Iparpolitika és ellátási lánc: a kínai drónokra/alkatrészekre vonatkozó tiltások után külön kérdés, mennyire tud az USA gyorsan, hazai vagy szövetségesi forrásból skálázni – és ez mennyire drágítja a rendszereket.

- Fronttapasztalat vs. „demo-hatás”: a Neros CTO-ja is arra utalt, hogy könnyű beleszeretni a látványos raj-demókba; az igazi kérdés, hogy a DAWG képes lesz-e a „menő bemutató” és a harctéren megbízható autonómia között különbséget tenni.